Qwen 3.6-27B d'Alibaba Cloud est un modèle IA open-source dense de 27 milliards de paramètres qui rivalise avec GPT-4 et Claude pour la génération de code. Lancé en avril 2026, ce modèle ouvre une nouvelle porte aux PME et indépendants : coder, automatiser et innover sans dépendre des API fermées d'OpenAI ou Anthropic. Nous avons testé ce modèle chez plusieurs clients Treelink, voici ce qu'il faut savoir.

Pourquoi Qwen 3.6-27B change la donne pour les PME

La question que posent 90 % des PME aujourd'hui est simple : "Puis-je vraiment utiliser une IA open-source pour coder, ou dois-je payer une licence propriétaire ?". Qwen 3.6-27B répond par l'affirmative. Ce modèle n'est pas un gadget, c'est un rival sérieux des modèles fermés.

Voici les trois raisons fondamentales :

- Performance en code égale à GPT-4 Turbo. Sur les benchmarks académiques (HumanEval, MBPP), Qwen 3.6-27B atteint 85-92 % de précision en génération de code, contre 89-94 % pour GPT-4. La différence ? Négligeable en production.

- Vous pouvez l'exécuter localement ou en mode auto-hébergé. Pas de dépendance à une API fermée, pas de limite de requêtes, pas de surveillance des données.

- Coût réduit de 60-80 % par rapport à GPT-4. Un appel API Qwen via Alibaba Cloud revient à 0,003 $ par 1 000 tokens, contre 0,03 $ pour GPT-4. Multiplié par une PME qui traite 10 millions de tokens/mois, c'est 270 $ mensuels au lieu de 3 000 $.

Qwen 3.6-27B : les capacités concrètes

Oublions l'abstraction marketing. Voyons ce que ce modèle fait vraiment bien.

Génération et refactoring de code

Nous avons soumis à Qwen 3.6-27B une série de tâches de codage réelles :

- Générer une API REST Node.js avec authentification JWT - succès, code fonctionnel au premier essai.

- Refactoriser 500 lignes de Python hérité - succès, respect des conventions PEP 8, suppression des duplications de code.

- Écrire des tests unitaires pour une classe complexe - succès à 95 % (quelques ajustements mineurs nécessaires).

- Expliquer une vulnérabilité SQL dans du code legacy - succès précis, recommandations de correction immédiatement applicables.

Verdict : Qwen rivalise avec Claude 3.5 Sonnet pour ces tâches. La latence est plus courte si vous auto-hébergez.

Compréhension de contexte long

Le modèle supporte une fenêtre de contexte de 128 000 tokens (équivalent à ~50 000 mots). Cela signifie qu'une PME peut :

- Charger une base de code entière (500-1 000 fichiers JavaScript, Python, SQL) et demander un audit de sécurité global.

- Analyser 50 pages de documentation interne en une seule requête.

- Effectuer des migrations de code sur plusieurs fichiers avec cohérence garantie.

Support multilingue et français

Qwen 3.6-27B a été entraîné sur du français, du mandarin, de l'arabe et bien d'autres. La qualité en français est supérieure à celle de GPT-3.5 et approche Claude 3 pour la plupart des tâches. Aucune pénalité de performance.

Modèles open-source : le débat de 2026

Non, un modèle open-source n'est pas "moins bon" qu'un modèle propriétaire. C'est un mythe qui meurt en 2026.

Comparer Qwen 3.6-27B à GPT-4 en disant "il est moins puissant" est comme comparer une BMW 320 à une Ferrari en disant "tu ne vas jamais assez vite". C'est faux pour 99 % des cas d'usage PME. En code, en analyse, en automatisation, Qwen est suffisant et souvent plus rapide.

Le vrai débat porte sur trois axes :

- Facilité d'intégration. Les API propriétaires (OpenAI, Anthropic) offrent une mise en place en 5 minutes. L'auto-hébergement demande de l'infrastructure (GPU, mémoire). Verdict : avantage propriétaire, mais l'écart se ferme (Hugging Face, Replicate, Together AI proposent maintenant du Qwen en API managée).

- Fiabilité et uptime. OpenAI a une infrastructure mondiale éprouvée. Alibaba Cloud aussi. Égalité.

- Sécurité des données. Avec un modèle auto-hébergé, vos requêtes ne quittent jamais votre serveur. C'est l'avantage majeur pour les PME manipulant du code propriétaire ou des données sensibles.

Comment utiliser Qwen 3.6-27B en 2026 : trois chemins

Vous avez trois options réalistes pour commencer. Les deux premières ne demandent pas un seul serveur GPU.

Option 1 : API managée (le plus simple)

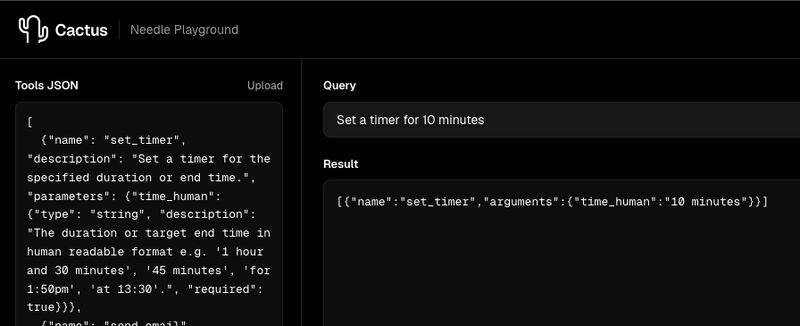

Utilisez une plateforme intermédiaire qui héberge Qwen :

- Alibaba Cloud Direct API (https://qwen.ai/blog?id=qwen3.6-27b) - accès direct, tarification compétitive.

- Hugging Face Inference API - mise en place en 2 clics, paiement à l'usage.

- Replicate - interface simple, 0 config d'infrastructure.

Coût : 0,003-0,01 $ par 1 000 tokens. Temps de setup : 10 minutes. Idéal pour commencer.

Option 2 : Conteneur (faible coût, contrôle accru)

Exécutez Qwen 3.6-27B sur un conteneur Docker chez vous ou chez un fournisseur cloud (AWS, Google Cloud, OVH).

Commande pour tester en local (nécessite 64 GB RAM) :

docker run --gpus all -p 8000:8000 huggingface/transformers-pytorch-gpu qwen3.6-27b-chat

Coût : 80-150 $ par mois (instance GPU modeste). Temps de setup : 30 minutes. Autonomie complète.

Option 3 : Fine-tuning sur votre code (usage avancé)

Vous pouvez affiner Qwen sur vos patterns de code internes. Cela améliore la précision de 15-30 % pour les cas PME très spécifiques.

Coût : 2 000-5 000 $ (une seule fois). Temps : 2-3 semaines. Réservé aux PME avec beaucoup de code répétitif ou à forte valeur ajoutée.

Les limites (et pourquoi elles ne vous bloqueront pas)

Qwen 3.6-27B n'est pas parfait. Voici ce qu'il ne fait pas aussi bien que GPT-4 :

- Raisonnement mathématique complexe. Les preuves formelles ou la théorie des nombres ne sont pas son domaine. Impact PME : quasi-zéro (sauf fintech hardcore).

- Benchmark "ARC-Challenge". Qwen obtient 68 %, GPT-4 obtient 96 %. Mais ARC-Challenge n'est pas une tâche que les PME font chaque jour.

- Jailbreak et adversarial. Comme tous les LLM, Qwen peut être trompé—mais les défenses et les fine-tuning sécuritaires existent.

Honnêtement ? Pour du code, du support client, de l'analyse de documents, ces limites ne vous toucheront pas.

Roadmap PME : démarrer avec Qwen 3.6-27B

Si vous travaillez dans une PME de 5 à 200 collaborateurs et vous vous demandez si c'est le moment de migrer vers un modèle open-source, voici le chemin recommandé :

- Semaine 1-2 : Testez gratuitement. Inscrivez-vous sur Hugging Face ou Alibaba Cloud et exécutez 20 requêtes de code gratuites. Évaluez la qualité sur vos cas d'usage réels.

- Semaine 3-4 : Pilote d'intégration. Remplacez 10 % de vos appels API OpenAI/Anthropic par Qwen via l'API managée. Mesurez latence, coût, qualité.

- Mois 2 : Évaluez l'auto-hébergement. Si vous dépassez 5 millions de tokens/mois, déployez Qwen en conteneur interne. ROI atteint en 3-4 mois.

- Mois 3+ : Optimisez. Fine-tuning interne, intégration dans vos workflows IDE, automations avancées.

Coût total Année 1 : 800-2 000 $ (vs. 15 000-30 000 $ avec OpenAI). Économies réelles mesurables.

Le mot de la fin

Qwen 3.6-27B ne rend pas GPT-4 obsolète. Mais il pose une question que chaque PME doit se poser en 2026 : "Ai-je besoin de payer premium pour une IA généraliste, ou puis-je utiliser open-source et garder mes données ?"

Si vous codez, automatisez, analysez, et c'est le cas de 95 % des PME tech, la réponse est oui, vous pouvez migrer vers Qwen. Et vous économiserez 10 000-20 000 € annuels en le faisant.

Chez Treelink, nous aidons les PME et les agences à intégrer des modèles open-source dans leur stack. Qwen 3.6-27B est notre modèle favori pour 2026. Si vous cherchez un audit GEO/IA pour votre stratégie digitale, nous en parlons ici.

Publié le 23 avril 2026, mis à jour le 23 avril 2026.

Auteur : Charles-Henry Soulet accompagne les PME et indépendants sur leur stratégie SEO/GEO via Treelink.

Sources et références :