Mercury-2 : Pourquoi l'architecture "Diffusion" change tout ?

Pendant que les géants comme Google et Meta optimisent leurs modèles séquentiels, Inception Labs, dirigé par le professeur Stefano Ermon de Stanford (co-créateur de techniques utilisées dans Stable Diffusion), a pris un chemin radicalement différent.

De la génération séquentielle au raffinage parallèle

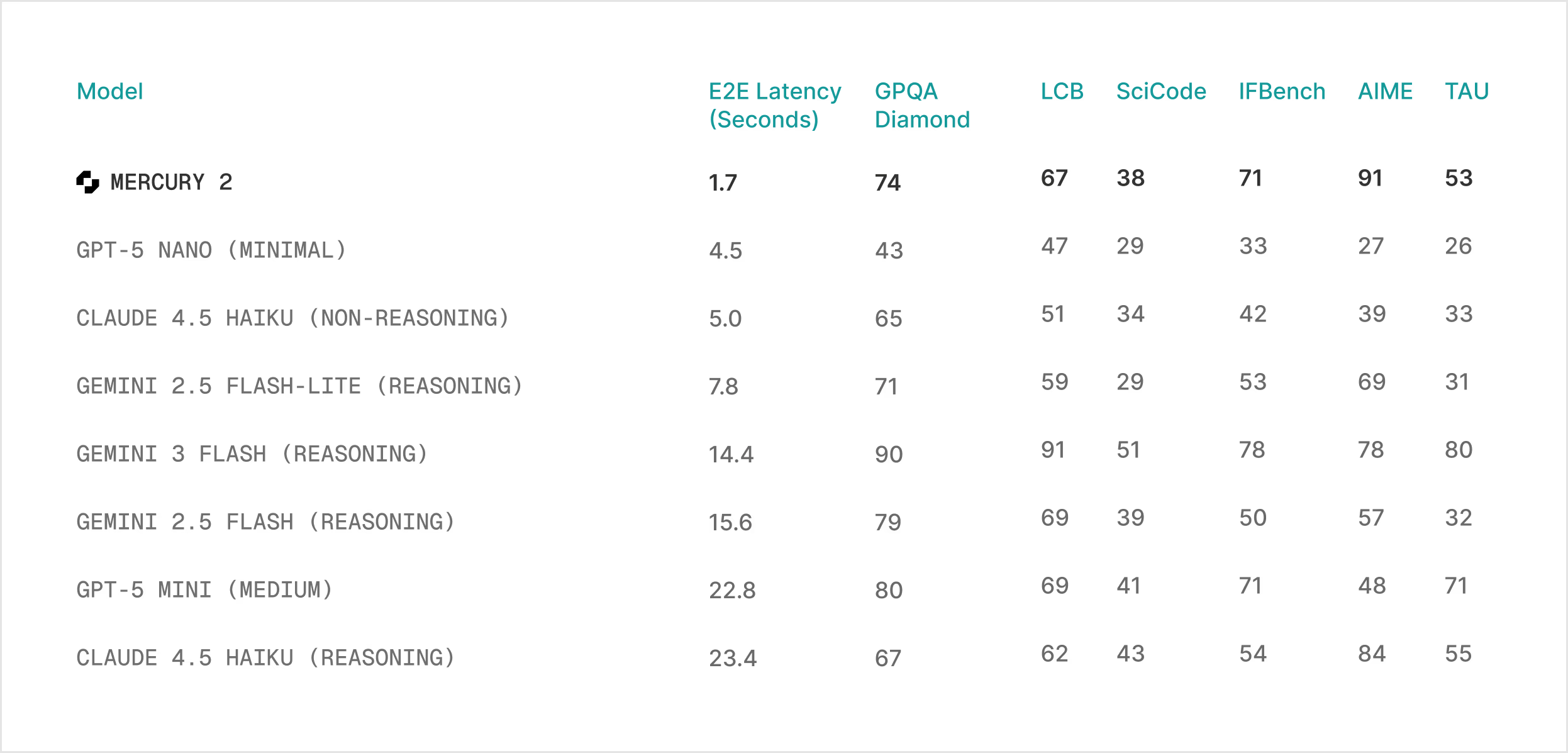

Les LLM traditionnels génèrent le texte mot après mot, ce qui crée un goulot d'étranglement lié à la bande passante mémoire. Mercury-2 utilise la diffusion pour le langage (dLLM) : il commence par une esquisse globale du texte et l'affine itérativement. Ce processus permet de traiter plusieurs parties de la réponse simultanément, maximisant ainsi l'efficacité des GPU d'entreprise.

Un raisonnement de pointe à un coût dérisoire

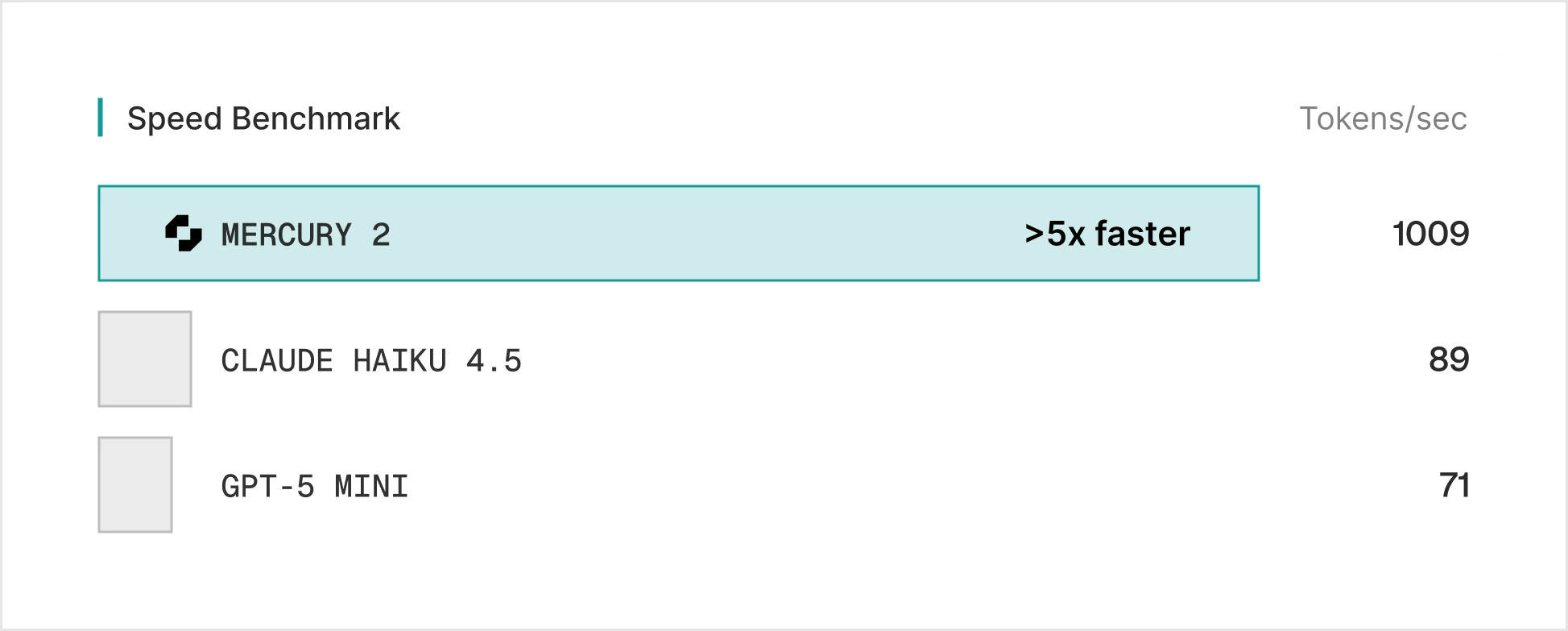

Sur les benchmarks comme GPQA et IFBench, Mercury-2 affiche des performances comparables à Claude 4.5 Haiku tout en étant 5x plus rapide. Son prix de 0,25 $par million de tokens d'entrée et 0,75$ en sortie le positionne comme l'option la plus agressive du marché pour les applications nécessitant du "Fast Reasoning".

Des agents de vente et support instantanés

L'une des principales frictions des chatbots actuels est le délai de réflexion. Avec Mercury-2, le temps de réponse devient "humain", idéal pour des intégrations sur WordPress via des API compatibles OpenAI. Cela permet d'augmenter le taux de conversion en offrant une assistance immédiate sans l'effet "robot qui écrit lentement".

Analyse de données massives en temps réel

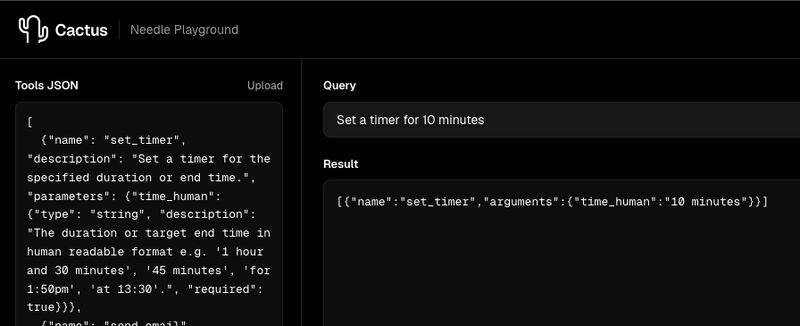

Grâce à sa fenêtre contextuelle de 128K tokens et son support natif des sorties structurées (JSON Schema), Mercury-2 peut auditer techniquement des milliers de pages web en quelques secondes. C'est un outil de choix pour les spécialistes du SEO technique qui doivent analyser des flux complexes de données sans exploser leur budget d'inférence.

Applications concrètes : Du code au service client

L'adoption de Mercury-2 par des leaders comme Amazon Bedrock et Azure AI Foundry montre que le modèle est prêt pour l'échelle industrielle.

Codage et édition de code ultra-rapide

Mercury-2 excelle dans les environnements de développement (IDE). Des outils comme Continue.dev ou Zed peuvent utiliser ce modèle pour suggérer des modifications de code complexes instantanément, permettant aux développeurs de rester dans leur flux créatif ("The Flow").

Recherche d'entreprise et RAG

Couplé à des systèmes de recherche comme SearchBlox, Mercury-2 transforme le RAG (Retrieval-Augmented Generation). Il peut synthétiser des dizaines de documents en une fraction de seconde, rendant la recherche interne en entreprise aussi fluide qu'une conversation.

Sécurité et Souveraineté : Un modèle pour les professionnels

Inception Labs met l'accent sur la confidentialité des données, un point crucial pour nos clients en Provence et dans le Var. Mercury-2 est compatible avec les déploiements en cloud privé, garantissant que les informations sensibles ne sortent jamais du périmètre de l'entreprise.